- 配置您的环境。

- 创建一个检索上下文并调用 LLM 的应用程序。

- 启用追踪以捕获检索步骤和 LLM 调用。

- 在 LangSmith UI 中查看生成的追踪记录。

先决条件

在开始之前,请确保您有:- LangSmith 账户:在 smith.langchain.com 注册或登录。

- LangSmith API 密钥:按照 创建 API 密钥 指南操作。

- OpenAI API 密钥:从 OpenAI 仪表板 生成。

1. 创建目录并安装依赖项

在终端中,为您的项目创建一个目录并在您的环境中安装依赖项:2. 设置环境变量

设置以下环境变量:LANGSMITH_TRACINGLANGSMITH_API_KEYOPENAI_API_KEY(或您的 LLM 提供商的 API 密钥)- (可选)

LANGSMITH_WORKSPACE_ID:如果您的 LangSmith API 链接到多个工作区,设置此变量以指定要使用的工作区。

3. 定义您的应用程序

您可以使用此步骤中概述的示例应用程序代码来检测 RAG 应用程序。或者,您可以使用包含 LLM 调用的自己的应用程序代码。 这是一个最小的 RAG 应用程序,它直接使用 OpenAI SDK,尚未添加任何 LangSmith 追踪。它有三个主要部分:- 检索器函数:模拟文档检索,始终返回相同的字符串。

- OpenAI 客户端:实例化一个普通的 OpenAI 客户端以发送聊天补全请求。

- RAG 函数:将检索到的文档与用户的问题结合形成系统提示,使用

gpt-4o-mini调用chat.completions.create()端点,并返回助手的响应。

app.py 或 app.ts):

4. 追踪 LLM 调用

首先,您将追踪所有 OpenAI 调用。LangSmith 提供包装器:- Python:

wrap_openai - TypeScript:

wrapOpenAI

-

在您的应用程序文件中包含高亮显示的行:

-

调用您的应用程序:

您将收到以下输出:

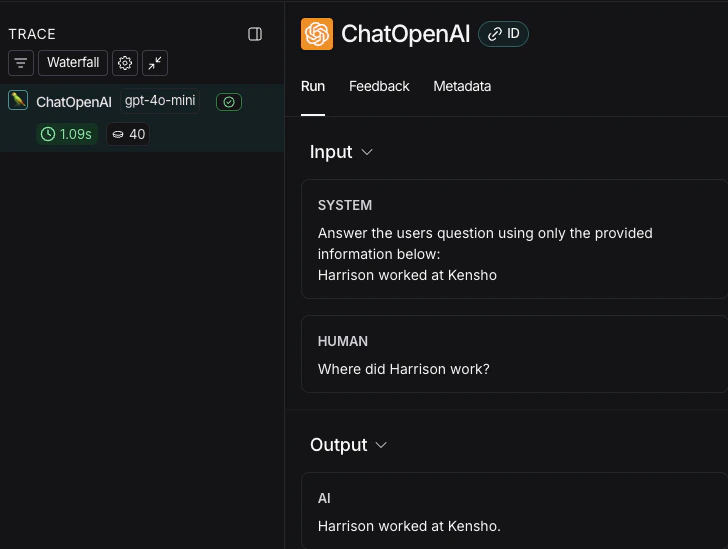

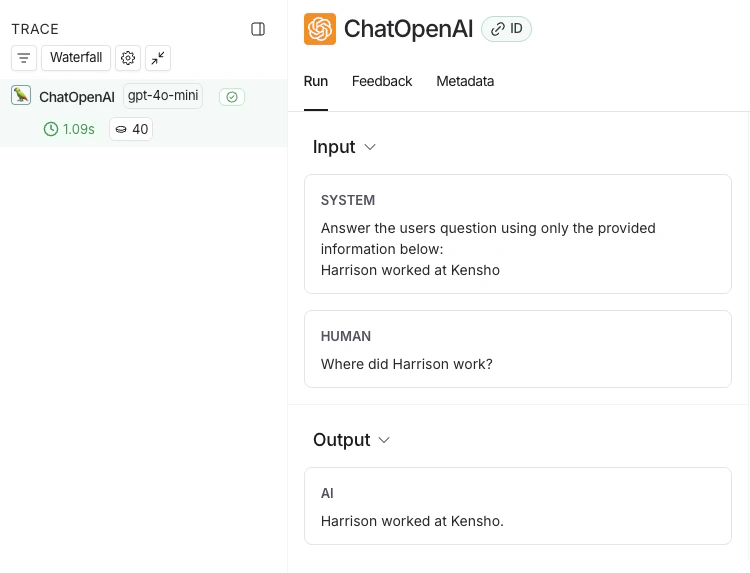

- 在 LangSmith UI 中,导航到您工作区的 default 追踪项目(或您在 步骤 2 中指定的工作区)。您将看到刚刚检测的 OpenAI 调用。

5. 追踪整个应用程序

您还可以使用 Python 的traceable 或 TypeScript 的 traceable 装饰器来追踪整个应用程序,而不仅仅是 LLM 调用。

-

在您的应用程序文件中包含高亮显示的代码:

-

再次调用应用程序以创建运行记录:

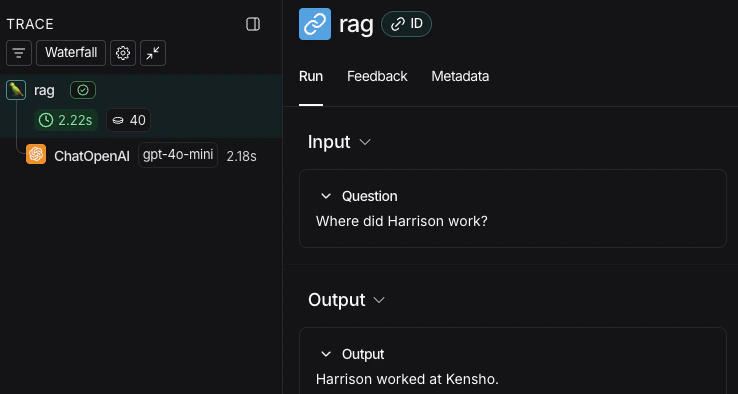

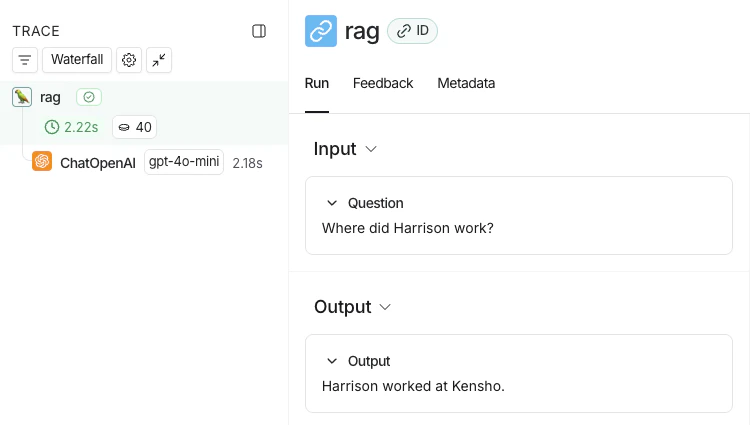

- 返回 LangSmith UI,导航到您工作区的 default 追踪项目(或您在 步骤 2 中指定的工作区)。您将找到整个应用程序管道的追踪记录,其中包含 rag 步骤和 ChatOpenAI LLM 调用。

后续步骤

以下是一些您可能接下来想探索的主题:- 追踪集成 为各种 LLM 提供商和代理框架提供支持。

- 筛选追踪记录 可以帮助您有效导航和分析包含大量数据的追踪项目中的数据。

- 追踪 RAG 应用程序 是一个完整的教程,它为应用程序从开发到生产添加可观测性。

- 将追踪记录发送到特定项目 更改追踪记录的目标项目。